Historia del hardware

Antecedentes de las escuelas de Wikipedia

Organizar una selección Wikipedia para las escuelas en el mundo en desarrollo sin acceso a Internet era una iniciativa de SOS Children. Haga clic aquí para obtener información sobre el apadrinamiento de niños.

| Historia de la informática |

|---|

| Hardware |

|

| Ciencias de la Computación |

|

| Los conceptos modernos |

|

| Cronología de la informática |

|

|

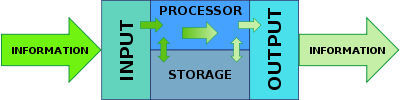

Hardware de computación evolucionó de máquinas que necesitan acción manual separado para realizar cada operación aritmética, a las máquinas de tarjetas perforadas, y luego a ordenadores de programa almacenado. La historia de los ordenadores de programa almacenado se refiere primero a la arquitectura de computadores, es decir, la organización de las unidades para realizar la entrada y salida, para almacenar datos y para operar como un mecanismo integrado.

Antes del desarrollo de la computadora de propósito general, la mayoría de los cálculos se realizaron por los seres humanos. Instrumento mecánico para ayudar a los seres humanos con los cálculos digitales entonces fueron llamados "máquinas de calcular", por nombres propios, o incluso como lo son ahora, calculadoras . Fueron esos seres humanos que utilizan las máquinas que fueron llamados entonces los ordenadores. Aparte de los números escritos, las primeras ayudas a la computación eran dispositivos puramente mecánicas que requieren que el operador establecer los valores iniciales de una operación aritmética elemental, entonces manipular el dispositivo para obtener el resultado. Un sofisticado (y comparativamente reciente) ejemplo es el regla de cálculo en la que los números se representan como longitudes en una escala logarítmica y el cálculo se realiza mediante el establecimiento de un cursor y la alineación de las escalas deslizantes, por lo tanto la adición de esas longitudes. Los números se pueden representar en una forma "analógica" continua, por ejemplo se creó una tensión o alguna otra propiedad física que sea proporcional al número. Los ordenadores analógicos, como los diseñados y construidos por Vannevar Bush antes de la Segunda Guerra Mundial fueron de este tipo. Los números pueden ser representados en forma de dígitos, manipulado automáticamente por un mecanismo mecánico. Aunque este último enfoque requiere mecanismos más complejos en muchos casos, que hizo que para una mayor precisión de los resultados.

En los Estados Unidos, el desarrollo de la computadora se basa en la inversión masiva del gobierno en la tecnología para aplicaciones militares durante la Segunda Guerra Mundial y después de la Guerra Fría. La confrontación entre superpotencias último hizo posible que los fabricantes locales a transformar sus máquinas en productos comercialmente viables. Fue la misma historia en Europa, donde la adopción de las computadoras comenzó en gran parte a través de medidas preventivas adoptadas por los gobiernos nacionales para estimular el desarrollo y el despliegue de la tecnología.

La invención de los amplificadores electrónicos hizo máquinas calculadoras mucho más rápido que sus predecesores mecánicos o electromecánicos. Tubo de vacío (válvula termoiónica) amplificadores dio paso al estado sólido transistores, y luego rápidamente a los circuitos integrados que continúan mejorando, la colocación de millones de interruptores eléctricos (normalmente transistores) en una sola pieza elaborada manufacturados de semi-conductor del tamaño de una uña. Al derrotar a la tiranía de los números, los circuitos integrados hizo de alta velocidad y las computadoras digitales de bajo costo en una mercancía generalizada. Hay un esfuerzo en curso para hacer hardware más rápido, más barato, y capaz de almacenar más datos.

Hardware de computación se ha convertido en una plataforma para usos distintos de la mera computación, tales como la automatización de procesos, las comunicaciones electrónicas, control de equipos, entretenimiento, educación, etc. Cada campo a su vez ha impuesto sus propias necesidades en el hardware, que ha evolucionado en respuesta a los requisitos, tales como el papel de la pantalla táctil para crear una más intuitiva y interfaz de usuario natural.

Como todos los ordenadores dependen de almacenamiento digital, y tienden a estar limitado por el tamaño y la velocidad de la memoria, la historia de Memoria está ligado al desarrollo de las computadoras.

Apertura de hardware verdad

Los dispositivos se han utilizado para ayudar a la computación desde hace miles de años, en su mayoría utilizando uno-a-uno correspondencia con nuestra los dedos. El dispositivo de recuento más temprano fue probablemente una forma de palillo de la cuenta. Ayudas de mantenimiento de registros posteriores en todo el Creciente Fértil incluyen cálculos (esferas de arcilla, conos, etc.) lo que representó el recuento de elementos, probablemente ganado o granos, sellados en contenedores. El uso de contando barras es un ejemplo.

El ábaco fue utilizado temprano para tareas aritméticas. Lo que ahora llamamos la Ábaco romano fue usado en Babilonia ya en 2400 antes de Cristo. Desde entonces, muchas otras formas de tableros de Juicio o tablas se han inventado. En una Europa medieval casa de cuenta, una tela a cuadros sería colocado en una mesa, y marcadores se movía alrededor de ella de acuerdo con ciertas reglas, como una ayuda para el cálculo de sumas de dinero.

Varios computadoras analógicas fueron construidos en tiempos antiguos y medievales para realizar cálculos astronómicos. Estos incluyen la Mecanismo de Anticitera y la astrolabio de la antigua Grecia (c. 150-100 aC), que se consideran generalmente como los ordenadores analógicos mecánicos conocidos más tempranos. Herón de Alejandría (c. 10-70 dC) hizo que muchos dispositivos mecánicos complejos, incluyendo autómatas y un carro programable. Otras versiones tempranas de dispositivos mecánicos utilizados para realizar uno u otro tipo de cálculos incluyen el planisferio y otros dispositivos informáticos mecánicos inventados por Al-Biruni (c 1000 dC.); la ecuatorio y astrolabio-latitud independiente universal Azarquiel (c AD 1015.); las computadoras analógicas astronómicas de otra medieval Los astrónomos e ingenieros musulmanes; y la reloj astronómico torre de Su Song (c. 1090 dC) durante la dinastía Song .

Matemático escocés y físico John Napier observó multiplicación y división de números podrían ser realizadas por la suma y la resta, respectivamente, de los logaritmos de los números. Mientras que la producción de las primeras tablas logarítmicas Napier necesaria para realizar muchas multiplicaciones, y fue en este punto que él diseñó Huesos de Napier, un dispositivo de ábaco similares utilizados para la multiplicación y la división. Dado que los números reales pueden ser representados como distancias o intervalos en una línea, la regla de cálculo fue inventado en la década de 1620 para permitir las operaciones de multiplicación y división que se llevarán a cabo mucho más rápido que antes era posible. Las reglas de cálculo fueron utilizados por generaciones de ingenieros y otros profesionales involucrados matemáticamente, hasta la invención de la calculadora de bolsillo .

Wilhelm Schickard, un alemán erudito, diseñó un reloj calcular en 1623. Se hizo uso de un engranaje de diente único que no era una solución adecuada para un mecanismo de transporte en general. Un incendio destruyó la máquina durante su construcción en 1624 y Schickard abandonó el proyecto. Dos bocetos de que fueron descubiertos en 1957, demasiado tarde para tener algún impacto en el desarrollo de calculadoras mecánicas.

En 1642, cuando todavía era un adolescente, Blaise Pascal comenzó algún trabajo pionero sobre máquinas calculadoras y después de tres años de esfuerzo y 50 prototipos inventó el calculadora mecánica. Él construyó veinte de estas máquinas (llamado Calculadora de Pascal o Pascaline) en los diez años siguientes. Nueve Pascalines han sobrevivido, la mayoría de los cuales están en exhibición en los museos europeos.

Gottfried Wilhelm von Leibniz inventó el Por escaleras Calculador y su cilindros famosos de todo 1672, mientras que la adición de la multiplicación y la división directa a la Pascaline. Leibniz, una vez dijo: "Es indigno de hombres excelentes que perder horas como esclavos en el trabajo de cálculo que con seguridad podría ser relegado a nadie si se utilizaran las máquinas."

Alrededor de 1820, Charles Xavier Thomas de Colmar creó la primera calculadora mecánica producida en serie tiene éxito, el Thomas Arithmometer, que podrían sumar, restar, multiplicar y dividir. Se basa principalmente en el trabajo de Leibniz. Las calculadoras mecánicas, como la base diez Addiator, la comptometer, la Monroe, la Curta y la Addo-X se mantuvo en uso hasta la década de 1970. Leibniz también describió el sistema de numeración binario , un ingrediente central de todas las computadoras modernas. Sin embargo, hasta la década de 1940, muchos diseños posteriores (incluyendo Charles Babbage máquinas del 1822 e incluso 's ENIAC de 1945) se basa en el sistema decimal; Contadores de anillo de ENIAC emularon el funcionamiento de las ruedas de dígitos de una máquina sumadora mecánica.

En Japón, Ryoichi Yazu patentó una calculadora mecánica llamada Yazu Arithmometer en 1903. Consistía en un solo cilindro y 22 marchas, y empleó el sistema mixto en base 2 y la base-5 número familiar a los usuarios de la soroban (ábaco japonés). Llevar y al final del cálculo se determina automáticamente. Más de 200 unidades fueron vendidas, principalmente a los organismos gubernamentales como el Ministerio de la Guerra y las estaciones experimentales agrícolas.

1801: la tecnología de tarjetas perforadas

En 1801, Joseph-Marie Jacquard desarrolló un telar en el que está tejiendo el patrón fue controlado por tarjetas perforadas. La serie de tarjetas podría ser cambiado sin cambiar el diseño mecánico del telar. Este fue un logro histórico en programación. Su máquina era una mejora sobre el tejido parecido telares. Tarjetas perforadas fueron precedidos por bandas perforadas, como en la máquina propuesta por Basile Bouchon. Estas bandas inspirarían información de grabación para los pianos automáticos y más recientemente NC máquinas herramienta.

En 1833, Charles Babbage pasó de desarrollar su máquina diferencial (para los cálculos de navegación) para un diseño de uso general, la máquina analítica, que atrajo directamente en tarjetas perforadas de Jacquard para su almacenamiento de programas. En 1837, Babbage describió su motor analítico. Era un ordenador programable de propósito general, empleando tarjetas perforadas para la entrada y un motor de vapor de poder, usando las posiciones de los engranajes y ejes para representar números. Su idea inicial era utilizar tarjetas perforadas para controlar una máquina capaz de calcular e imprimir tablas logarítmicas con gran precisión (una máquina de propósito especial). Idea de Babbage pronto se convirtió en un ordenador programable de propósito general. Mientras que su diseño era el sonido y los planes eran probablemente correcta, o al menos depurable, el proyecto fue frenado por diversos problemas, incluyendo los conflictos con las partes principales de construcción maquinista para ello. Babbage era un hombre difícil de trabajar y discutió con todos. Todas las piezas para su máquina se tuvieron que hacer a mano. Pequeños errores en cada artículo pueden resumir en ocasiones para causar grandes discrepancias. En una máquina con miles de piezas, que requerían estas piezas a ser mucho mejor que las tolerancias usuales necesarios en el momento, se trataba de un problema importante. El proyecto se disolvió en disputas con el artesano que construye partes y terminó con la decisión del Gobierno británico a cesar la financiación. Ada Lovelace, Lord Byron hija 's, traducido y añadido notas al "Boceto de la Máquina Analítica" por Federico Luigi, Conte Menabrea. Esta parece ser la primera descripción publicada de la programación.

Una reconstrucción de la Diferencia Engine II, una anterior diseño, más limitada, ha estado en funcionamiento desde 1991 en el Museo de la Ciencia de Londres. Con algunos cambios triviales, funciona exactamente como Babbage la diseñó y demuestra que las ideas de diseño de Babbage eran correctas, simplemente demasiado adelantado a su tiempo. El museo utiliza máquinas herramientas controladas por ordenador para la construcción de las piezas necesarias, utilizando tolerancias un buen maquinista del período habría sido capaz de lograr. Fracaso de Babbage para completar la máquina analítica puede atribuye principalmente a las dificultades no sólo de la política y la financiación, sino también a su deseo de desarrollar un equipo cada vez más sofisticados y para avanzar más rápido que nadie pudo seguir.

Una máquina basada en máquina diferencial de Babbage fue construido en 1843 por Per Georg Scheutz y su hijo Eduardo. Un motor de cálculo Scheutzian mejorado fue vendido al gobierno británico y un modelo más tarde fue vendido al gobierno de Estados Unidos y estos fueron utilizados con éxito en la producción de tablas logarítmicas.

Después de Babbage, aunque inconsciente de su trabajo anterior, fue Percy Ludgate, un contador de Dublin, Irlanda. Él independientemente diseñó una computadora mecánica programable, que describió en un trabajo que fue publicado en 1909.

1880: el almacenamiento de datos de tarjetas perforadas

A finales de la década de 1880, la American Herman Hollerith inventó el almacenamiento de datos en un medio que podría entonces ser leído por una máquina. Usos anteriores de la máquina medios legibles habían sido para el control ( tales como autómatas rollos de pianola o telares), no datos. "Después de algunos ensayos iniciales con cinta de papel, se decidió por tarjetas perforadas ... "Hollerith llegó a utilizar tarjetas perforadas después de observar cómo conductores del ferrocarril codificados características personales de cada pasajero con golpes en sus entradas. Para procesar estas tarjetas perforadas que inventó el tabulador, y el máquina perforadora clave. Estos tres inventos fueron la base de la moderna industria de procesamiento de la información. Sus máquinas usadas de mechanical relés (y solenoides) para incrementar contadores mecánicos. El método de Hollerith se usó en la 1890 Estados Unidos Censo y los resultados completos fueron "... meses terminados antes de lo previsto y ahora en el marco del presupuesto". De hecho, el censo se procesó año más rápido que el censo antes había sido. Empresa de Hollerith eventualmente se convirtió en el núcleo de IBM . IBM desarrolló la tecnología de tarjetas perforadas en una poderosa herramienta para el procesamiento de datos de negocios y produce una amplia línea de equipos de registro de la unidad. Para 1950, la tarjeta IBM había convertido en omnipresente en la industria y el gobierno. La advertencia impresa en la mayoría de las tarjetas destinadas a la circulación como documentos (cheques, por ejemplo), "No doblar, husillo o mutilan ", se convirtió en un eslogan para la era post-Segunda Guerra Mundial.

Artículos de Leslie Comrie sobre métodos de tarjetas perforadas y Publicación de WJ Eckert de perforadas Métodos de tarjetas en Computación Científica en 1940, las técnicas de tarjetas perforadas descritas suficientemente avanzados para resolver algunas ecuaciones diferenciales o realizar la multiplicación y división, usando representaciones de punto flotante, todo en tarjetas perforadas y máquinas de registro de la unidad. Esas mismas máquinas se habían utilizado durante la Segunda Guerra Mundial para el procesamiento estadístico criptográfico. En la imagen del tabulador (ver a la izquierda), tenga en cuenta la panel de control, que es visible en el lado derecho de la tabulador. Una fila de interruptores de palanca está por encima del panel de control. La Thomas J. Watson Astronómica Informática Mesa, Universidad de Columbia realizó cálculos astronómicos que representan el estado de la técnica en computing.

La programación de computadoras en la era de tarjetas perforadas se centró en el "centro de cómputo". Los usuarios de ordenadores, por ejemplo los estudiantes de ciencias e ingeniería en las universidades, presentarían sus tareas de programación a su centro de cómputo local en forma de una baraja de tarjetas perforadas, una tarjeta por línea de programa. Luego tuvieron que esperar a que el programa se pueda leer en, en cola para su procesamiento, compilado y ejecutado. En su momento, una copia impresa de cualquier resultado, marcado con la identificación del remitente, se coloca en una bandeja de salida, por lo general en el vestíbulo del centro de ordenador. En muchos casos, estos resultados serían sólo una serie de mensajes de error, requiriendo otra ciclo editar-punch-compile a ejecutar. Tarjetas perforadas todavía se utilizan y fabrican para este día, y sus dimensiones distintivas (y capacidad de 80 columnas) todavía se pueden reconocer en los formularios, registros y programas en todo el mundo. Son del tamaño de papel moneda estadounidense en el tiempo de Hollerith, una elección que hizo porque ya había equipos disponibles para manejar las cuentas.

Calculadoras de escritorio

En el siglo 20, las calculadoras mecánicas anteriores, cajas registradoras, máquinas de contabilidad, y así sucesivamente fueron rediseñados para utilizar motores eléctricos, con posición de la marcha como la representación del estado de una variable. La palabra "ordenador" era un puesto de trabajo asignado a las personas que utilizan estas calculadoras para realizar cálculos matemáticos. Por la década de 1920 El interés de Lewis Fry Richardson en la predicción del tiempo le llevó a proponer equipos humanos y análisis numérico para modelar el clima; para el día de hoy, los ordenadores más potentes en la Tierra son necesarios para modelar adecuadamente su tiempo utilizando la Ecuaciones de Navier-Stokes.

Empresas como Friden, Marchant Calculadora y Monroe hizo escritorio mecánica calculadoras de la década de 1930 que podrían sumar, restar, multiplicar y dividir. Durante el Proyecto Manhattan, futuro premio Nobel Richard Feynman fue el supervisor de computadoras humanos que entendieron el uso de ecuaciones diferenciales que se estaban resueltos para el esfuerzo de guerra.

En 1948, la Curta fue introducido. Esta fue una pequeña calculadora, portátiles, mecánico que era del tamaño de un molinillo de pimienta. Con el tiempo, durante los años 1950 y 1960 una variedad de diferentes marcas de calculadoras mecánicas apareció en el mercado. La primera calculadora de escritorio todo-electrónica fueron los británicos ANITA Mk.VII, que utilizó un Pantalla de tubo Nixie y 177 subminiatura tubos tiratrón. En junio de 1963, Friden introdujo el de cuatro funciones EC-130. Tenía una capacidad de diseño todo-transistor, 13 dígitos en un 5 pulgadas (130 mm) CRT, e introdujo Notación polaca inversa (RPN) para el mercado de las calculadoras a un precio de $ 2.200. El modelo EC-132 añade raíz cuadrada y funciones recíprocas. En 1965, Wang Laboratorios produjo el LOCI-2, una calculadora de escritorio de transistores de 10 dígitos que utiliza una pantalla de tubo Nixie y podría calcular logaritmos .

En los primeros días de las computadoras válvulas de vacío binarios, su fiabilidad era lo suficientemente pobres para justificar la comercialización de una versión octal mecánica ("Binary octal") de la calculadora de escritorio Marchant. Fue pensado para comprobar y verificar los resultados del cálculo de dichos equipos.

Computadores analógicos avanzada

Antes de la Segunda Guerra Mundial , mecánica y eléctrica computadoras analógicas fueron considerados el "estado del arte", y muchos pensaban que eran el futuro de la informática. Los ordenadores analógicos aprovechan la gran similitud entre las matemáticas de propiedades -la pequeña escala posición y el movimiento de las ruedas o el voltaje y la corriente de componentes electrónicos y las matemáticas de otros fenómenos físicos, por ejemplo, trayectorias balísticas, la inercia, la resonancia, transferencia de energía, impulso, y así sucesivamente. Modelan fenómenos físicos con eléctrica voltajes y corrientes como las cantidades analógicas.

En el centro, estos sistemas analógicos funcionan creando eléctrica ' análogos de 'de otros sistemas, lo que permite a los usuarios predecir el comportamiento de los sistemas de interés mediante la observación de los análogos eléctricos. El más útil de las analogías fue la forma en que el comportamiento a pequeña escala puede ser representado con las ecuaciones integrales y diferenciales, y se puede por lo tanto utilizarse para resolver esas ecuaciones. Un ejemplo ingenioso de tal máquina, usando agua como la cantidad analógica, fue el integrador de agua construido en 1928; un ejemplo eléctrica es la Máquina Mallock construida en 1941. A planímetro es un dispositivo que hace integrales, utilizando la distancia como la cantidad analógica. A diferencia de las computadoras digitales modernas, las computadoras análogas no son muy flexibles, y necesitan ser reconectado manualmente para cambiar ellos de trabajar en un problema a otro. Los ordenadores analógicos tenían una ventaja sobre los ordenadores digitales tempranos en que se podrían utilizar para resolver problemas complejos utilizando análogos de comportamiento, mientras que los primeros intentos de computadoras digitales eran bastante limitado.

Algunas de las computadoras analógicas más ampliamente desplegados dispositivos para armas dirigidas, como el incluido Bombsight Norden, y sistemas de control de fuego, tales como Argo sistema de Arthur Polen para los buques de guerra. Algunos se quedaron en uso durante décadas después de la Segunda Guerra Mundial; la Mark I Fuego Control Computarizado se desplegó por la Marina de Estados Unidos en una variedad de naves de destructores a los acorazados . Otras computadoras analógicas incluyen la Heathkit EC-1, y la hidráulica Moniac ordenador que modela flujos econométricos.

El arte de la computación analógica mecánica alcanzó su cenit con la analizador diferencial, construido por HL Hazen y Vannevar Bush en MIT a partir de 1927, que a su vez construida sobre los integradores mecánicos inventados en 1876 por James Thomson y los amplificadores de par inventadas por HW Nieman. Una docena de estos dispositivos fueron construidos antes de su obsolescencia era evidente; el más poderoso se construyó en el Universidad de Pennsylvania de Escuela Moore de Ingeniería Eléctrica, donde el ENIAC fue construida. Computadoras electrónicas digitales, como el ENIAC significó el fin de la mayoría de máquinas de computación analógica, pero las computadoras analógicas híbrido, controlados por la electrónica digital, permanecieron en uso sustancial en los años 1950 y 1960, y más tarde en algunas aplicaciones especializadas.

Temprano computación digital electrónica

La era de la computación moderna empezó con una ráfaga de desarrollo antes y durante la Segunda Guerra Mundial.

A primeros componentes electromecánicos fueron empleados como relés. George Stibitz es reconocido internacionalmente como uno de los padres de la computadora digital moderna. Mientras trabajaba en los Laboratorios Bell en noviembre de 1937, Stibitz inventó y construyó una calculadora basada en relés que él denominó la "Modelo K" (de "mesa de la cocina", en el que había montado él), que fue el primero en calcular el uso de forma binaria .

Sin embargo, elementos de circuitos electrónicos reemplazan sus equivalentes mecánicos y electromecánicos, y los cálculos digitales reemplazaron los cálculos analógicos. Máquinas tales como la Z3, la Atanasoff Berry Computer, el Computadoras Colossus, y la ENIAC fueron construidas a mano usando circuitos que contienen relés o válvulas (tubos de vacío), y se utiliza a menudo tarjetas perforadas o cinta perforada para la entrada y como el (no volátil) medio de almacenamiento principal. Definición de un solo punto en la serie como el "primer equipo" pierde muchas sutilezas (ver la tabla "Definición de características de algunos primeras computadoras digitales de la década de 1940" a continuación).

Turing

Alan Turing de papel 's 1936 demostró una enorme influencia en la informática y ciencias de la computación de dos maneras. Su objetivo principal era demostrar que había problemas (a saber, la problema de la parada) que no pudo ser resuelto por cualquier proceso secuencial. Al hacerlo, Turing proporciona una definición de un ordenador universal que ejecuta un programa almacenado en la cinta. Esta construcción se dio en llamar una Máquina de Turing. Con excepción de las limitaciones impuestas por sus almacenes de memoria finitas, las computadoras modernas se dice que son -Turing completa, es decir, tienen algoritmo de capacidad de ejecución equivalente a una máquina universal de Turing.

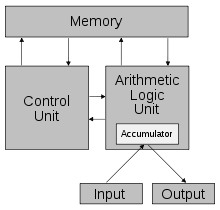

Para una máquina de computación para ser un ordenador de uso general práctico, debe haber algún mecanismo conveniente de lectura-escritura, cinta perforada, por ejemplo. Con el conocimiento de teórico 'máquina de computación universal "de Alan Turing John von Neumann define una arquitectura que utiliza el mismo memoria tanto para almacenar programas y datos: prácticamente todas las computadoras modernas utilizan esta arquitectura (o alguna variante). Aunque en teoría es posible implementar un equipo completo totalmente mecánica (como el diseño de Babbage mostró), hicieron posible la electrónica de la velocidad y más tarde la miniaturización que caracterizan a las computadoras modernas.

Había tres corrientes paralelas de desarrollo informático en la era de la Segunda Guerra Mundial; la primera corriente en gran medida ignorado, y la segunda corriente mantiene deliberadamente secreto. El primero fue el trabajo alemán de Konrad Zuse. El segundo fue el desarrollo secreto de los ordenadores Colossus en el Reino Unido. Ninguno de ellos tenía mucha influencia en los diversos proyectos de computación en los Estados Unidos, pero algunos de la tecnología LED, a través de Turing y otros, para la primera computadora electrónica comercial. La tercera corriente de desarrollo informático era Eckert y ENIAC y EDVAC de Mauchly, que fue ampliamente publicitado.

Zuse

Trabajar de manera aislada en Alemania, Konrad Zuse comenzó la construcción en 1936 de sus calculadoras primera serie Z que ofrece la memoria y (inicialmente limitada) programabilidad. Zuse de puramente mecánico, pero ya binaria Z1, terminado en 1938, nunca funcionó de manera fiable debido a problemas con la precisión de las piezas.

Máquina después de Zuse, el Z3, se terminó en 1941. Se basaba en relés de teléfono y funcionaba satisfactoriamente. Así, el Z3 se convirtió en el primer programa controlado, para todo uso, ordenador digital funcional del mundo. En muchos aspectos, era bastante similar a las máquinas modernas, numerosos avances pioneros, como Los números de coma flotante. Sustitución del sistema decimal difíciles de aplicar (utilizado en Charles Babbage diseño anterior 's) por el simple binario sistema significó que las máquinas de Zuse eran más fáciles de construir y potencialmente más fiable, dadas las tecnologías disponibles en ese momento.

Los programas se introducen en Z3 en películas perforadas. Los saltos condicionales faltaban, pero desde la década de 1990 se ha demostrado teóricamente que Z3 seguía siendo un ordenador universal (como siempre, haciendo caso omiso de las limitaciones físicas de almacenamiento). En dos 1936 solicitudes de patentes, Konrad Zuse también anticipó que las instrucciones de la máquina pueden ser almacenados en el mismo almacenamiento utilizado para datos de la idea clave de lo que se conoció como la arquitectura von Neumann, primero implementado en el British SSEM de 1948. Zuse también afirmó haber diseñado el primer nivel superior lenguaje de programación , a la que llamó Plankalkül, en 1945 (publicado en 1948) a pesar de que se puso en práctica por primera vez en 1998 y nuevamente en 2000 por un equipo de alrededor de Raúl Rojas en el Universidad Libre de Berlín.

Zuse sufrió reveses durante la Segunda Guerra Mundial, cuando algunos de sus máquinas fueron destruidas en el curso de Campañas de bombardeos aliados. Al parecer se mantuvo en gran parte desconocido a los ingenieros en el Reino Unido y los Estados Unidos hasta mucho más tarde su trabajo, aunque por lo menos IBM era consciente de ello, ya que financió su compañía de lanzamiento de la posguerra en 1946 a cambio de una opción sobre las patentes de Zuse.

Coloso

Durante la Segunda Guerra Mundial, los británicos en Bletchley Park (40 millas al norte de Londres) logró una serie de éxitos a romper las comunicaciones militares alemanas cifradas. La máquina de cifrado alemán, Enigma , fue atacado con la ayuda de máquinas electromecánicas llamada bombes. La bombe, diseñado por Alan Turing y Gordon Welchman, después de la criptografía polaca bomba por Marian Rejewski (1938), entró en uso productivo en 1941. Ellos descartaron posibles ajustes Enigma realizando cadenas de deducciones lógicas implementadas eléctricamente. La mayoría de las posibilidades llevaron a una contradicción, y los pocos que quedan podría ser probado con la mano.

Los alemanes también desarrollaron una serie de sistemas de encriptación teletipo, bastante diferente de Enigma. La Lorenz SZ 40/42 máquina se utiliza para las comunicaciones del ejército de alto nivel, denominado "Atún" por los británicos. Las primeras intercepciones de mensajes Lorenz comenzaron en 1941. Como parte de un ataque a los atunes, Max Newman y sus colegas ayudaron a especificar el Coloso. El Colossus Mk I fue construido entre marzo y diciembre de 1943 por Tommy Flowers y sus colegas de la Post Office Research Station en Dollis Hill en Londres y luego enviados a Bletchley Park en enero de 1944.

Colossus fue el primer dispositivo de computación programable electrónica del mundo. Se utiliza un gran número de válvulas (tubos de vacío). Tenía entrada de papel-cinta y era capaz de ser configurado para realizar una variedad de lógicas booleanas operaciones sobre sus datos, pero no fue Turing-completo. Nueve Mk II Colosos se construyeron (El Mk me convertí en un Mk II haciendo diez máquinas en total). Los detalles de su existencia, el diseño y uso se mantuvieron en secreto hasta bien entrada la década de 1970. Winston Churchill dictó personalmente una orden para su destrucción en pedazos no más grandes que la mano de un hombre, de mantener en secreto que los británicos eran capaces de craqueo Lorenz durante el frío que se aproxima guerra. Dos de las máquinas fueron trasladados a la recién formada GCHQ y los demás fueron destruidos. Como resultado, las máquinas no se incluyeron en muchas historias de la computación. Una copia de trabajo reconstruido de una de las máquinas Colossus está ahora en exhibición en Bletchley Park.

Desarrollos americanos

En 1937, Claude Shannon mostró hay una uno-a-uno correspondencia entre los conceptos de la lógica booleana y ciertos circuitos eléctricos, que ahora se llama puertas lógicas, que ahora son ubicuos en las computadoras digitales. En su tesis de maestría en MIT, por primera vez en la historia, Shannon mostró que los relés electrónicos e interruptores pueden realizar la expresiones de Álgebra de Boole. Intitulado Un Análisis Simbólico de relé y circuitos de conmutación, la tesis de Shannon básicamente fundó práctico diseño de circuitos digitales. George Stibitz completó un equipo basado en relés que llamó el "Modelo K" en Bell Labs en noviembre de 1937. Bell Labs autorizó un programa de investigación completo a finales de 1938 con Stibitz al timón. Su Calculadora de números complejos, completó 08 de enero 1940, fue capaz de calcular los números complejos . En una demostración de la Conferencia de la American Mathematical Society en Dartmouth College, el 11 de septiembre de 1940, Stibitz pudo enviar la Calculadora de números complejos comandos remotos a través de líneas telefónicas por un teletipo. Fue la primera máquina de computación utilizado alguna vez de forma remota, en este caso a través de una línea telefónica. Algunos de los participantes en la conferencia que fue testigo de la demostración fueron John von Neumann , John Mauchly, y Norbert Wiener, quien escribió sobre él en sus memorias.

En 1939, John Vincent Atanasoff y Clifford E. Berry, de la Universidad Estatal de Iowa desarrollaron el Atanasoff Berry Computer (ABC), La Atanasoff Berry Computer fue el primer ordenador digital electrónico del mundo. El diseño utilizado más de 300 tubos de vacío y empleó condensadores fijos en un tambor giratorio mecánicamente para la memoria. Aunque la máquina ABC no era programable, que fue el primero en utilizar tubos electrónicos en un sumador. ENIAC co-inventor John Mauchly examinó la ABC en junio de 1941, y su influencia en el diseño de la máquina después ENIAC es un tema de discusión entre los historiadores de la computadora. El ABC fue olvidado en gran medida hasta que se convirtió en el foco de la demanda Honeywell v. Sperry Rand, el fallo de que invalidó la patente de ENIAC (y varios otros), entre muchas razones, haber sido anticipado por el trabajo de Atanasoff.

En 1939, el desarrollo comenzó en los laboratorios de Endicott de IBM en la Harvard Marcos I. conocido oficialmente como el Automatic Sequence Controlled Calculadora, la Mark I fue un equipo electro-mecánico de uso general construido con financiación de IBM y con la asistencia del personal de IBM, bajo la dirección del matemático de Harvard Howard Aiken. Su diseño fue influenciado por la Máquina Analítica de Babbage, usando aritméticas y almacenamiento ruedas decimales y conmutadores rotatorios además de relés electromagnéticos. Fue programable a través de cinta de papel perforado, y contenía varias unidades de cálculo que trabajan en paralelo. Las versiones posteriores contenían varios lectores de cinta de papel y la máquina podría cambiar entre lectores basados en una condición. Sin embargo, la máquina no era bastante-Turing completo. La marca me trasladaron a La Universidad de Harvard y comenzó la operación 05 1944.

ENIAC

La ENIAC construida en Estados Unidos (Electronic Numerical Integrator y Computer) fue la primera computadora electrónica de propósito general. Combinó, por primera vez, la alta velocidad de la electrónica con la capacidad de ser programado para muchos problemas complejos. Se podría añadir o restar 5.000 veces por segundo, mil veces más rápido que cualquier otra máquina. También tenía módulos para multiplicar, dividir y raíz cuadrada. De memoria de alta velocidad estaba limitada a 20 palabras (cerca de 80 bytes). Construido bajo la dirección de John Mauchly y J. Presper Eckert en la Universidad de Pennsylvania, el desarrollo y la construcción del ENIAC duró desde 1943 a pleno funcionamiento a finales de 1945. La máquina era enorme, con un peso de 30 toneladas, con 200 kilovatios de energía eléctrica y más de 18.000 tubos de vacío contenidas, 1.500 relés, y cientos de miles de resistencias, condensadores, e inductores. Una de las mayores hazañas de ingeniería fue para minimizar el desgaste del tubo, lo que era un problema común en esa época. La máquina estaba en uso casi constante durante los próximos diez años.

ENIAC era inequívocamente un dispositivo Turing-completo. Podría calcular ningún problema (que encajaría en la memoria). Un "programa" en la ENIAC, sin embargo, fue definido por los estados de sus cables e interruptores de conexión, muy lejos de las máquinas electrónicas de programa almacenado que vinieron después. Una vez que el programa fue escrito, que tuvo que ser fijado mecánicamente en la máquina. Seis mujeres hicieron la mayor parte de la programación de ENIAC. (Las mejoras realizadas en 1948 han permitido ejecutar programas almacenados en la memoria establecidos tabla de funciones, lo que hizo un esfuerzo "one-off" de programación menos, y más sistemática).

"Bebé" de Manchester

La Pequeña Escala Máquina Experimental Manchester, apodadobebé, fue la primera del mundo computadora con programa almacenado.Fue construido en laUniversidad Victoria de Manchester porFrederic C. Williams,Tom Kilburn y Geoff Tootill, y corrió su primer programa en 21 de junio 1948.

La máquina no estaba destinado a ser un equipo práctico, pero en cambio se ha diseñado como un banco de pruebas para el tubo de Williams, una forma temprana de la memoria del ordenador. Aunque se considera "pequeña y primitiva" por los estándares de su época, fue la primera máquina que trabaja para contener todos los elementos esenciales para un equipo electrónico moderno. Tan pronto como el SSEM había demostrado la viabilidad de su diseño, se inició un proyecto en la universidad para desarrollar en un equipo más fácil de usar, el Manchester marca 1. La marca 1 a su vez se convirtió rápidamente en el prototipo de la marca Ferranti 1, el primero ordenador de propósito general disponible comercialmente del mundo.

El SSEM tenía un 32 bit longitud de la palabra y una memoria de 32 palabras. Como se ha diseñado para ser la computadora de programa almacenado más simple posible, las únicas operaciones aritméticas implementadas en hardware fueron sustracción y la negación; otras operaciones aritméticas fueron implementados en software. El primero de los tres programas escritos para la máquina encontró el mayor divisor propio de 2 18 (262.144), un cálculo que se conocía tomaría mucho tiempo de gestión y así demostrar la fiabilidad por de la computadora prueba de cada número entero de 2 18 - 1 a la baja, como la división fue implementado por sustracción repetida del divisor. El programa consistió en 17 instrucciones y corrió durante 52 minutos antes de llegar a la respuesta correcta de 131.072, después de la SSEM había realizado 3,5 millones de operaciones (para una velocidad de CPU efectiva de 1,1 Kips).

Características de ordenador tempranos

| Nombre | Primero operativa | Sistema de numeración | Mecanismo de Informática | Programación | Turing completa |

|---|---|---|---|---|---|

| ZuseZ3(Alemania) | 05 1941 | Binario punto flotante | Electro-mecánica | Programa controlado por los puñetazos 35 mmacción de la película (pero ninguna rama condicional) | En teoría( 1998) |

| Atanasoff Berry Computer(US) | 1942 | Binario | Electrónico | Propósito no programable single- | No |

| Coloso Marcos 1(Reino Unido) | 02 1944 | Binario | Electrónico | Programa controlado por los cables de conexión y los interruptores | No |

| Harvard Mark I - IBM ASCC(US) | 05 1944 | Decimal | Electro-mecánica | Programa controlado por 24 canalescinta de papel perforado (pero ninguna rama condicional) | Discutible |

| Colossus Marcos 2 (Reino Unido) | 06 1944 | Binario | Electrónico | Programa controlado por los cables de conexión y los interruptores | En teoría(2011) |

| ZuseZ4(Alemania) | 03 1945 | Punto flotante binario | Electro-mecánica | Programa controlado por un puñetazo de película de 35 mm de stock | Sí |

| ENIAC(US) | 07 1946 | Decimal | Electrónico | Programa controlado por los cables de conexión y los interruptores | Sí |

| Ssem (Baby)(Reino Unido) | 06 1948 | Binario | Electrónico | -Programa almacenado enla memoria Williams tubo de rayos catódicos | Sí |

| Modificado ENIAC(US) | 09 1948 | Decimal | Electrónico | Sólo lectura mecanismo de programación almacenado utilizando las Tablas de funciones como el programa ROM | Sí |

| EDSAC(Reino Unido) | 05 1949 | Binario | Electrónico | -Programa almacenado en el mercuriode memoria de línea de retardo | Sí |

| Manchester Marcos 1(Reino Unido) | Octubre 1949 | Binario | Electrónico | -Programa almacenado en la memoria Williams tubo de rayos catódicos yla memoria de tambor magnético | Sí |

| CSIRAC(Australia) | 11 1949 | Binario | Electrónico | -Programa almacenado en la memoria de línea de retardo de mercurio | Sí |

Máquinas de primera generación

Incluso antes de la ENIAC se terminó, Eckert y Mauchly reconocieron sus limitaciones y comenzaron el diseño de una computadora con programa almacenado, EDVAC. John von Neumann fue acreditado con un informe de amplia circulación que describe el diseño del EDVAC en el que se almacenan tanto los programas y datos de trabajo en una sola, tienda unificada. Este diseño básico, que se denota la arquitectura von Neumann, serviría de base para el desarrollo en todo el mundo de los sucesores de ENIAC. En esta generación de equipo, almacenamiento temporal o de trabajo fue proporcionado por acústicos líneas de retardo, que utilizan el tiempo de propagación del sonido a través de un medio tal como líquido de mercurio (o a través de un cable) para almacenar datos brevemente. Una serie de pulsos acústicos se envía a lo largo de un tubo; después de un tiempo, como el pulso alcanza el extremo del tubo, el circuito detecta si el pulso representaba un 1 o 0 y causó el oscilador de volver a enviar el pulso. Otros utilizaron tubos de Williams, que utilizan la capacidad de un tubo de rayos catódicos pequeña (CRT) para almacenar y recuperar datos como áreas cargadas en la pantalla de fósforo. Para 1954, memoria de núcleo magnético estaba desplazando rápidamente la mayoría de otras formas de almacenamiento temporal, y dominó el campo a través de la década de 1970.

EDVAC fue la primera computadora de programa almacenado diseñado; sin embargo, no fue el primero en correr. Eckert y Mauchly abandonaron el proyecto y su construcción fracasaron. El primer trabajo de la máquina de von Neumann fue el Manchester "Baby" o Experimental Machine en pequeña escala, desarrollada por Frederic C. Williams y Tom Kilburn en la Universidad de Manchester en 1948 como un banco de pruebas para el tubo de Williams; fue seguido en 1949 por el equipo de Manchester Marcos 1, un sistema completo, con tubo de Williams y la memoria de tambor magnético, y la introducción de registros de índice. El otro contendiente por el título de "primera computadora de programa almacenado digital" había sido EDSAC, diseñado y construido en la Universidad de Cambridge . Operacional menos de un año después de que el Manchester "Baby", también era capaz de hacer frente a los problemas reales. EDSAC fue inspirado en realidad por los planes para EDVAC (Electronic Discrete Variable Automatic Computer), el sucesor de ENIAC; estos planes ya estaban en su lugar para el momento ENIAC fue exitosamente operacional. A diferencia de ENIAC, que utiliza el procesamiento paralelo, EDVAC usó una sola unidad de procesamiento. Este diseño era más simple y fue el primero en ser implementado en cada ola sucesiva de la miniaturización, y el aumento de la fiabilidad. Algunos ven Manchester Marcos 1 / EDSAC / EDVAC como el "Evas" de la que casi todos los ordenadores actuales derivan su arquitectura. Máquina de la Universidad de Manchester se convirtió en el prototipo de la Ferranti Marcos 1. La primera Ferranti Marcos 1 máquina fue entregada a la Universidad en febrero de 1951 y al menos otras nueve fueron vendidos entre 1951 y 1957.

La primera computadora programable universal en la Unión Soviética fue creado por un equipo de científicos bajo la dirección de Sergei Lebedev Alekseyevich de Kiev Instituto de electrotecnia, Unión Soviética (ahora Ucrania ). El ordenador HSHAV ( МЭСМ , Pequeño electrónico Máquina calculadora ) entró en funcionamiento en 1950. tenía alrededor de 6.000 tubos de vacío y se consume 25 kW de potencia. Podría realizar aproximadamente 3.000 operaciones por segundo. Otra máquina primitiva era CSIRAC, un diseño australiano que corrió su primer programa de pruebas en 1949. CSIRAC es la computadora más antigua todavía en existencia y el primero en haber sido utilizado para reproducir música digital.

Computadoras comerciales

La primera computadora comercial era la Ferranti Mark 1, la cual fue entregada a la Universidad de Manchester en febrero de 1951. Se basaba en la marca Manchester 1. Las principales mejoras con respecto a la marca Manchester 1 estaban en el tamaño del almacenamiento primario (utilizando al azar Acceso Williams tubos), almacenamiento secundario (utilizando un tambor magnético), un multiplicador más rápido, y las instrucciones adicionales. El tiempo de ciclo básico era 1,2 milisegundos, y una multiplicación se pudo completar en aproximadamente 2,16 milisegundos. El multiplicador utilizado casi una cuarta parte de los tubos de vacío 4050 de la máquina (válvulas). Una segunda máquina fue comprada por la Universidad de Toronto, antes de que el diseño ha sido revisado a la marca de 1 estrella. Al menos siete de estas máquinas posteriores fueron entregados entre 1953 y 1957, uno de ellos para Shell laboratorios en Ámsterdam .

En octubre de 1947, los directores de J. Lyons & Company, una empresa de catering británico famoso por sus salones de té, pero con fuertes intereses en las nuevas técnicas de gestión de oficina, decidieron tomar un papel activo en la promoción del desarrollo comercial de las computadoras. La LEO I equipo entró en funcionamiento en abril de 1951 y corrieron el primero regulares mundo rutina de computadora de la oficina de empleo. El 17 de noviembre 1951, la compañía J. Lyons Comenzó su actividad semanal de un trabajo de valoración de panadería en el LEO (Lyons Electronic Office). Esta fue la primera empresa de aplicaciones para ir a vivir en un ordenador de programa almacenado.

En junio de 1951, el UNIVAC I (Universal Automatic Computer) fue entregado a la Oficina del Censo de los Estados Unidos. Remington Rand eventualmente vendió 46 máquinas en más de $ 1 millón cada uno ($ 8.840.000 a partir de 2013). UNIVAC fue la primera computadora "producida en masa". Solía 5.200 tubos de vacío y se consume 125 kW de potencia. Su almacenamiento primario era de serie de acceso líneas de retardo de mercurio capaz de almacenar 1.000 palabras de 11 dígitos decimales signo más (palabras de 72 bits). Una característica clave del sistema UNIVAC era un tipo recién inventado de cinta magnética metal, y una unidad de cinta de alta velocidad, para el almacenamiento no volátil. La cinta magnética se sigue utilizando en muchos ordenadores. En 1952, IBM anunció públicamente la máquina de procesamiento electrónico de datos de IBM 701, el primero en su exitosa serie 700/7000 y su primera computadora central IBM. La IBM 704, introducido en 1954, que se utiliza la memoria de núcleo magnético, que se convirtió en el estándar para las máquinas grandes. La primera marcha alto nivel de propósito general lenguaje de programación , Fortran, fue también siendo desarrollado en IBM por 704 durante 1955 y 1956 y lanzado a principios de 1957. (1945 diseño de Konrad Zuse del lenguaje de alto nivel Plankalkül no fue implementado en ese momento .) Un voluntario de grupos de usuarios, que existe hasta hoy, fue fundada en 1955 para compartir su software y experiencias con el IBM 701.

IBM introdujo un equipo más pequeño, más asequible en 1954 que resultó muy popular. La IBM 650 pesaba más de 900 kg, la fuente de alimentación conectada pesaba alrededor de 1.350 kg y ambos se llevaron a cabo en gabinetes separados de aproximadamente 1,5 metros por 0,9 metros por 1,8 metros. Nos costó $ 500.000 (4.270.000 dólares a partir de 2013), o podría ser alquilado por 3.500 dólares al mes ($ 30 mil al 2013). Su memoria de tambor era originalmente 2.000 palabras de diez dígitos, luego se expandió a 4.000 palabras. Limitaciones de memoria como ésta fueron dominando la programación durante décadas después. Las instrucciones del programa se fue a buscar desde el tambor de giro como el código corrió. La ejecución de memoria de tambor usando Eficiente fue proporcionada por una combinación de arquitectura de hardware: el formato de instrucciones incluido la dirección de la siguiente instrucción; y software: el Programa Asamblea Optimal Simbólico, SOAP, instrucciones asignadas a las direcciones óptimas (en la medida posible por el análisis estático del programa fuente). Así, muchas instrucciones fueron, cuando sea necesario, que se encuentra en la siguiente fila del tambor para ser leídos y no se requería tiempo de espera adicional para la rotación del tambor.

En 1955, Maurice Wilkes inventa la microprogramación, que permite la instrucción de base fijado por definir o ampliado por los programas integrados (ahora llamado firmware o microcódigo). Fue ampliamente utilizado en las CPUs y unidades de punto flotante de mainframe y otros equipos, como el Manchester Atlas y el serie IBM 360.

IBM introdujo la primeraunidad de almacenamiento en disco (unaunidad de disco duro), elIBM 350 RAMAC (acceso aleatorio Método de Contabilidad y Control) en 1956. El uso de cincuenta de 24 pulgadas (610 mm) discos de metal, con 100 pistas por lado, fue capaz de almacenar 5megabytes de datos a un costo de 10.000 dólares por megabyte (80.000 dólares a partir de 2013).

Segunda generación: transistores

El bipolar transistor fue inventado en 1947. Desde 1955 en adelante transistores sustituyen los tubos de vacío en los diseños de computadora, dando lugar a la "segunda generación" de computadoras. Inicialmente los únicos dispositivos disponibles eran de germanio transistores de punto de contacto, que aunque menos fiables que los tubos de vacío reemplazaron tenía la ventaja de consumir mucha menos energía. La primera ordenador transistorizado fue construido a la Universidad de Manchester y estaba en funcionamiento en 1953; una segunda versión se terminó allí en abril de 1955. La máquina más tarde utilizado 200 transistores y 1300 de estado sólido diodos y tenía un consumo de energía de 150 vatios. Sin embargo, todavía se requiere válvulas para generar las formas de onda de reloj de 125 kHz y para leer y escribir en la magnética memoria de tambor, mientras que el Harwell CADETE operado sin ninguna válvula utilizando una menor frecuencia de reloj, de 58 kHz cuando entró en funcionamiento en febrero de 1955 . Los problemas con la fiabilidad de los primeros lotes de punto de contacto y transistores de unión aleados significaba que de la máquina de tiempo medio entre fallos era de unos 90 minutos, pero esto mejoró una vez que los más fiables transistores de unión bipolar estuvieron disponibles.

En comparación con los tubos de vacío, transistores tienen muchas ventajas: son más pequeños, y requieren menos energía que los tubos de vacío, por lo que emiten menos calor. Transistores de unión silicio eran mucho más fiable que los tubos de vacío y tenía más tiempo, indefinido, vida de servicio. Ordenadores transistorizados podrían contener decenas de miles de circuitos lógicos binarios en un espacio relativamente compacto. Transistores reducen considerablemente el tamaño de los equipos de los, costo inicial y los costos de operación. Por lo general, las computadoras de segunda generación estaban compuestas de un gran número de tarjetas de circuitos impresos, tales como el Sistema Modular Estándar IBM cada uno con tres y cincuenta y nueve puertas lógicas o chanclas.

Un equipo de segunda generación, el IBM 1401, capturado cerca de un tercio del mercado mundial. IBM instalado más de diez mil 1401 entre 1960 y 1964.

La electrónica de transistores mejoran no sólo la CPU (Central Processing Unit), sino también los dispositivos periféricos. Los generación segunda unidades de almacenamiento de datos del disco fueron capaces de almacenar decenas de millones de letras y dígitos. Al lado de las unidades de almacenamiento de disco fijo, conectados a la CPU a través de la transmisión de datos de alta velocidad, eran unidades de disco de almacenamiento de datos extraíbles. Un extraíble paquete de disco puede ser fácilmente intercambiado con otro paquete en unos pocos segundos. Incluso si la capacidad de los discos extraíbles 'es menor que los discos fijos, su intercambiabilidad garantiza una cantidad casi ilimitada de datos a la mano. La cinta magnética proporciona la capacidad de archivo de estos datos, a un costo más bajo que el disco.

Muchos CPUs de segunda generación delegadas de comunicaciones de dispositivos periféricos a un procesador secundario. Por ejemplo, mientras que el procesador de comunicaciones controlado cartomancia y puñetazos, la CPU principal ejecuta cálculos y binarios instrucciones de bifurcación. Uno databus llevaría datos entre la CPU principal y la memoria central en la de la CPU velocidad de ciclo se ha podido ir a ejecutar, y otras databusses típicamente servir al dispositivos periféricos. En el PDP-1, tiempo de ciclo de la memoria del núcleo era 5 microsegundos; en consecuencia, más instrucciones aritméticas tomaron 10 microsegundos (100.000 operaciones por segundo) porque la mayoría de las operaciones se llevaron al menos dos ciclos de memoria; uno para la instrucción, una para el operando de datos FETCH.

Durante la segunda generación de unidades terminales remotas (a menudo en forma de máquinas de teletipo como un Friden Flexowriter) sierra aumentó enormemente su uso. Las conexiones telefónicas proporcionan suficiente velocidad para terminales remotos comienzos y permitieron a cientos de kilómetros de separación entre terminales remotas y el centro de cómputo. Con el tiempo estas redes de ordenadores independientes se pueden generalizar en una interconectado a la red de redes -los Internet.

Post-1960: tercera generación y más allá

La explosión en el uso de las computadoras comenzó con las computadoras "tercera generación", haciendo uso dede Jack St. Clair Kilby yla invención independiente de Robert Noyce delcircuito integrado(o microchip), que llevó a la invención de la microprocesador.Mientras que el tema de la exactitud cuyo dispositivo fue el primer microprocesador es polémico, en parte debido a la falta de acuerdo sobre la definición exacta del término "microprocesador", es en gran medida indiscutible que el primer microprocesador de un solo chip fue el Intel 4004, diseñado y realizado porTed Hoff,Federico Faggin, y Stanley Mazor enIntel.

Mientras que los ICs primeros microprocesadores literalmente sólo contenía el procesador, es decir, la unidad de procesamiento central, de un ordenador, su desarrollo progresivo llevó naturalmente a los chips que contienen la mayoría o todos los componentes electrónicos internos de un ordenador. El circuito integrado en la imagen de la derecha, por ejemplo, un Intel 8742, es un 8-bit microcontrolador que incluye una CPU funcionando a 12 MHz, 128 bytes de RAM, 2048 bytes de EPROM, y I / O en el mismo chip .

Durante la década de 1960 hubo un considerable solapamiento entre las tecnologías de segunda y tercera generación. IBM implementó sus módulos de Tecnología Lógica Solid IBM en circuitos híbridos para el IBM System / 360 en 1964. Todavía en 1975, Sperry Univac continuó la fabricación de máquinas de segunda generación, como los UNIVAC 494. La grandes sistemas de Burroughs como el B5000 fueron máquinas de pila, lo que permitió la programación más simple. Estos autómatas pushdown también fueron implementados en miniordenadores y microprocesadores posteriores, que influyeron en el diseño de lenguajes de programación. Minicomputadoras servido como centros de computación de bajo costo para la industria, las empresas y las universidades. Se hizo posible simular circuitos analógicos con el programa de simulación con énfasis circuito integrado o SPICE (1971) en minicomputadoras, uno de los programas para la automatización de diseño electrónico ( EDA). El microprocesador llevó al desarrollo de las microcomputadoras, pequeños ordenadores y de bajo costo que podría ser propiedad de individuos y pequeñas empresas. Microcomputadoras, la primera de las cuales aparecieron en la década de 1970, se convirtió en omnipresente en la década de 1980 y más allá.

En abril de 1975 en la Feria de Hannover, se presentó elP6060 producido porOlivetti, primer ordenador personal del mundo con una función de disquete: Unidad Central en dos placas, nombres en clave PUCE1 / PUCE2,componentes TTL hizo, 8 "simple o dobledisquete disco decontrolador, 32 caracteres alfanuméricospantalla de plasma, 80 columnas gráficaimpresora térmica, 48 Kbytes deRAM,BASIClenguaje, 40 kilogramos de peso. Él estaba en competencia con un producto similar por parte de IBM, pero con un disquete externa.

MOS Technology KIM-1 y Altair 8800, fueron vendidas como kits de hágalo usted mismo, como fue el Apple I, poco después. El primer ordenador de Apple con capacidades gráficas y de sonido salió bien después de la Commodore PET. Informática ha evolucionado con las arquitecturas de microcomputadoras, con características añadidas de sus hermanos más grandes, ahora dominante en la mayoría de los segmentos del mercado.

Sistemas tan complicado como computadoras requieren muy alta fiabilidad. ENIAC quedó orientado, en la operación continua desde 1947 hasta 1955, durante ocho años antes de ser apagado. Aunque un tubo de vacío puede fallar, sería reemplazado sin cerrar el sistema. Por la sencilla estrategia de no cerrar ENIAC, los fracasos se redujeron drásticamente. El tubo de vacío equipos de defensa aérea SAGE convirtieron muy fiable -. Instalada en pares, uno fuera de línea, tubos probables a fallar por lo que cuando el equipo estaba dirigido intencionalmente a potencia reducida para encontrarlos hizo discos duros conectables en caliente, como el calor tubos de vacío -pluggable de antaño, continúan la tradición de reparación durante la operación continua. Memorias de los semiconductores habitualmente no tienen errores cuando operan, aunque los sistemas operativos como Unix han empleado pruebas de memoria en el arranque para detectar el hardware falla. Hoy en día, la exigencia de un rendimiento fiable se hace aún más estrictos cuando las granjas de servidores son la plataforma de entrega. Google ha logrado esto mediante el uso de software tolerante a fallos para recuperarse de los fallos de hardware, e incluso está trabajando en el concepto de sustitución de las granjas de servidores enteros sobre la marcha, durante un evento de servicio.

En el siglo 21, las CPU multi-core se convirtieron comercialmente disponible. memoria de contenido direccionable (CAM) se ha convertido en lo suficientemente barato para ser utilizado en la creación de redes, aunque ningún sistema informático sin embargo ha implementado CAMs de hardware para su uso en los lenguajes de programación. Actualmente, CAM (o matrices asociativas) en el software están programando específica de lengua. Arreglos de celdas de memoria de semiconductores son estructuras muy regulares, y los fabricantes prueban sus procesos en ellos; esto permite que las reducciones de precios en los productos de memoria. Durante la década de 1980, CMOS puertas lógicas desarrollaron en los dispositivos que se podrían hacer tan rápido como otros tipos de circuitos; Por lo tanto, el consumo de potencia de los ordenadores podría reducirse drásticamente. A diferencia del consumo de corriente continua de una puerta sobre la base de otros tipos de lógica, una puerta CMOS sólo se consume corriente significativa durante la "transición" entre estados lógicos, a excepción de las fugas.

Esto ha permitido a la informática para convertirse en una mercancía que es ahora omnipresente, incrustado en muchas formas, desde tarjetas de felicitación y teléfonos de satélites. Informática hardware y su software, incluso se han convertido en una metáfora del funcionamiento del universo. Aunque computación basada en ADN y la computación cuántica son años o décadas en el futuro, la infraestructura está siendo despedidos hoy, por ejemplo, con el origami de ADN en la fotolitografía y con antenas cuántica para la transferencia de información entre las trampas de iones. Para el 2011, los investigadores habían enredado 14 qubits. Rápido circuitos digitales (incluyendo los basados en uniones Josephson y rápida tecnología de cuanto de flujo individual) son cada vez más cerca de realización con el descubrimiento de los superconductores a nanoescala.

Fibra óptica y dispositivos fotónicos, que ya han sido utilizados para el transporte de datos a través de largas distancias, están entrando ahora en el centro de datos, al lado de los componentes de la CPU y de la memoria de semiconductores. Esto permite la separación de la RAM de la CPU mediante interconexiones ópticas. IBM ha creado un circuito integrado con tanto electrónico y óptico (esto se llama fotónico ) de procesamiento de información en un solo chip. Esto se denota "nanofotónica CMOS integrados" o (CINP).

Una indicación de la rapidez del desarrollo de este campo se puede deducir por la historia de la artículo seminal. En el momento en que alguien tuvo tiempo de escribir nada, era obsoleto. Después de 1945, otros leen de John von Neumann primer borrador de un informe sobre el EDVAC , e inmediatamente comenzaron a aplicar sus propios sistemas. A día de hoy, el ritmo de desarrollo ha continuado, en todo el mundo.